J'ai peur. Très effrayé.

La surveillance et la censure à l’échelle d’Internet, rendues possibles par la puissance de calcul inimaginable de l’intelligence artificielle (IA), sont là.

Ce n’est pas une dystopie futuriste. Cela se produit maintenant.

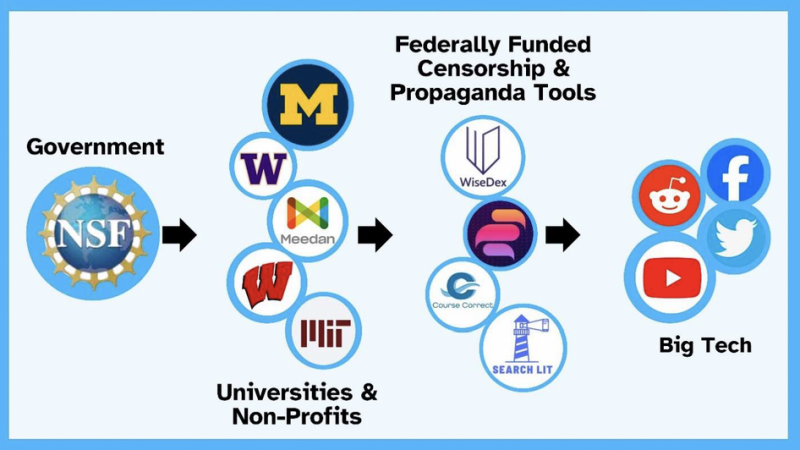

Les agences gouvernementales travaillent avec des universités et des organisations à but non lucratif pour utiliser des outils d'IA afin de surveiller et de censurer le contenu sur Internet.

Ce n’est ni politique ni partisan. Il ne s’agit pas d’une opinion ou d’une idée particulière.

Ce qui se passe, c'est qu'un outil suffisamment puissant pour surveiller tout ce qui est dit et fait sur Internet (ou une grande partie de celui-ci) devient disponible pour le gouvernement afin de nous surveiller tous, à tout moment. Et, sur la base de cette surveillance, le gouvernement – et toute organisation ou entreprise avec laquelle le gouvernement s'associe – peut alors utiliser le même outil pour supprimer, réduire au silence et faire taire tout discours qui ne lui plaît pas.

Mais ce n'est pas tout. En utilisant le même outil, le gouvernement et ses partenaires public-privé « non gouvernementaux » (pensez, par exemple : l’Organisation mondiale de la santé ou Monsanto) peuvent également suspendre toute activité liée à Internet. Effectuer des opérations bancaires, acheter, vendre, enseigner, apprendre, se divertir, se connecter les uns aux autres – si l’IA contrôlée par le gouvernement n’aime pas ce que vous (ou vos enfants !) dites dans un tweet ou un e-mail, elle peut arrêter tout cela pendant un moment. toi.

Oui, nous l'avons vu à une échelle très locale et politisée avec, par exemple, les camionneurs canadiens.

Mais si nous pensions que ce type d’activité ne pourrait pas, ou ne se produirait pas, se produire à l’échelle nationale (ou même, plus effrayante – mondiale), nous devons nous réveiller maintenant et réaliser que cela se produit et qu’il n’est peut-être pas possible de l’arrêter.

De nouveaux documents montrent que l’IA financée par le gouvernement est destinée à la censure en ligne

Le sous-comité spécial de la Chambre des représentants des États-Unis sur la militarisation du gouvernement fédéral a été créée en janvier 2023 « pour enquêter sur les questions liées à la collecte, à l’analyse, à la diffusion et à l’utilisation d’informations sur les citoyens américains par les agences du pouvoir exécutif, notamment si ces efforts sont illégaux, inconstitutionnels ou contraires à l’éthique ».

Malheureusement, le travail du comité est considéré, même par ses propres membres, comme largement politique : les législateurs conservateurs enquêtent sur ce qu'ils perçoivent comme une réduction au silence des voix conservatrices par des agences gouvernementales de tendance libérale.

Néanmoins, au cours de ses enquêtes, cette commission a découvert des documents étonnants liés aux tentatives du gouvernement de censurer le discours des citoyens américains.

Ces documents ont des implications cruciales et terrifiantes pour l’ensemble de la société.

Dans le rapport intérimaire du Sous-comité, daté du 5 février 2024, des documents montrent que des groupes universitaires et à but non lucratif proposent à une agence gouvernementale d'utiliser les « services de désinformation » de l'IA pour censurer le contenu des plateformes Internet.

Plus précisément, l'Université du Michigan explique à la National Science Foundation (NSF) que les outils basés sur l'IA financés par la NSF peuvent être utilisés pour aider les plateformes de médias sociaux à mener des activités de censure sans avoir à prendre de décisions sur ce qui doit être censuré.

Voici comment la relation est visualisée dans le rapport du Sous-comité :

Voici une citation précise présentée dans le rapport du Sous-comité. Il provient des « Notes du présentateur du premier discours de l'Université du Michigan à la National Science Foundation (NSF) au sujet de son outil WiseDex, financé par la NSF et alimenté par l'IA. » Les notes sont déposées auprès du comité.

Notre service de désinformation aide les décideurs politiques des plateformes qui souhaitent… rejeter la responsabilité de jugements difficiles sur une personne extérieure à l'entreprise… en externalisant la difficile responsabilité de la censure.

Il s’agit d’une déclaration extraordinaire à bien des niveaux :

- Il assimile explicitement les « services de désinformation » à la censure.

Il s’agit d’une équation cruciale, car les gouvernements du monde entier prétendent lutter contre la désinformation préjudiciable alors qu’en réalité ils le font. adopter des projets de loi de censure massifsL’ Le WEF a déclaré « la désinformation et la désinformation » constituent les « risques mondiaux les plus graves » au cours des deux prochaines années, ce qui signifie vraisemblablement que leurs plus grands efforts seront dirigés vers la censure.

Lorsqu’un entrepreneur gouvernemental déclare explicitement qu’il vend un « service de désinformation » qui aide les plateformes en ligne à « externaliser la censure », les deux termes sont reconnus comme étant interchangeables.

- Il qualifie la censure de « responsabilité ».

En d’autres termes, cela suppose qu’une partie de ce que les plateformes devraient faire est la censure. Ne pas protéger les enfants des prédateurs sexuels ou les citoyens innocents de la désinformation – simplement une censure pure et simple.

- Il affirme que le rôle de l’IA est d’« externaliser » la responsabilité de la censure.

Les plateformes Tech ne veulent pas prendre de décisions de censure. Le gouvernement veut prendre ces décisions, mais il ne veut pas être perçu comme un censeur. Les outils d’IA permettent aux plateformes « d’externaliser » les décisions de censure et au gouvernement de cacher ses activités de censure.

Tout cela devrait mettre fin à l’illusion selon laquelle ce que les gouvernements du monde entier appellent « lutter contre la désinformation et les discours de haine » n’est pas une simple censure.

Que se passe-t-il lorsque la censure de l’IA est pleinement mise en œuvre ?

Sachant que le gouvernement finance déjà des outils de censure de l’IA, nous devons réfléchir à ce que cela implique.

Aucune limite de main d’œuvre : Comme le souligne le rapport du Sous-comité, les limites de la censure gouvernementale en ligne ont jusqu'à présent impliqué le grand nombre d'humains nécessaires pour parcourir des fichiers sans fin et prendre des décisions de censure. Avec l’IA, presque aucun humain n’a besoin d’être impliqué, et la quantité de données pouvant être surveillées peut être aussi vaste que tout ce que quelqu’un dit sur une plateforme particulière. Une telle quantité de données est incompréhensible pour un cerveau humain individuel.

Personne n'est responsable : L’un des aspects les plus effrayants de la censure de l’IA est que lorsque l’IA le fait, aucun être humain ou organisation – qu’il s’agisse du gouvernement, des plateformes ou de l’université ou des organisations à but non lucratif – n’est réellement responsable de la censure. Au départ, les humains fournissent à l’outil d’IA des instructions sur les catégories ou les types de langage à censurer, mais ensuite la machine continue et prend elle-même les décisions au cas par cas.

Aucun recours pour les griefs : Une fois que l’IA sera déchaînée avec un ensemble d’instructions de censure, elle balayera des milliards de points de données en ligne et appliquera des actions de censure. Si vous souhaitez contester une action de censure de l’IA, vous devrez parler à la machine. Peut-être que les plateformes emploieront des humains pour répondre aux appels. Mais pourquoi feraient-ils cela, alors qu’ils disposent d’une IA capable d’automatiser ces réponses ?

Aucune protection pour les jeunes : L’une des affirmations des censeurs gouvernementaux est que nous devons protéger nos enfants des informations nuisibles en ligne, comme les contenus qui les rendent anorexiques, les encouragent à se suicider, les transforment en terroristes de l’EI, etc. Également de l'exploitation sexuelle. Ce sont toutes des questions graves qui méritent attention. Mais elles ne sont pas aussi dangereuses pour un grand nombre de jeunes que la censure de l’IA.

Le danger posé par la censure de l’IA s’applique à tous les jeunes qui passent beaucoup de temps en ligne, car cela signifie que leurs activités et leur langage en ligne peuvent être surveillés et utilisés contre eux – peut-être pas maintenant, mais chaque fois que le gouvernement décide de s’en prendre à un type particulier. du langage ou du comportement. Il s’agit d’un danger bien plus grand pour un nombre bien plus grand d’enfants que le danger posé par n’importe quel contenu spécifique, car il englobe toutes les activités qu’ils mènent en ligne, touchant presque tous les aspects de leur vie.

Voici un exemple pour illustrer ce danger : Disons que votre adolescent joue à de nombreux jeux vidéo interactifs en ligne. Disons qu'il privilégie les jeux conçus par des entreprises chinoises. Peut-être qu'il regarde aussi les autres jouer à ces jeux et participe à des discussions et à des groupes de discussion sur ces jeux, auxquels participent également de nombreux ressortissants chinois.

Le gouvernement pourrait décider le mois prochain, ou l’année prochaine, que toute personne fortement impliquée dans les jeux vidéo de conception chinoise constitue un danger pour la démocratie. Cela pourrait entraîner la fermeture des comptes de réseaux sociaux de votre fils ou son refus d'accéder à des outils financiers, comme des prêts universitaires. Cela peut également impliquer de le signaler sur des sites Web d’emploi ou de rencontres comme dangereux ou indésirable. Cela pourrait signifier qu’il se voit refuser un passeport ou qu’il est inscrit sur une liste de surveillance.

La vie de votre adolescent est devenue beaucoup plus difficile. Beaucoup plus difficile que s’il était exposé à une vidéo de recrutement de l’Etat islamique ou à une publication TikTok glorifiant le suicide. Et cela se produirait à une échelle bien plus grande que celle l'exploitation sexuelle dont se servent les censeurs comme un cheval de Troie pour normaliser l'idée de censure gouvernementale en ligne.

Services de censure monétisables: Un outil d'IA appartenant au gouvernement peut théoriquement être utilisé par une entité non gouvernementale avec l'autorisation du gouvernement, et avec la bénédiction des plateformes qui veulent « externaliser » la « responsabilité » de la censure. Ainsi, même si le gouvernement peut utiliser l’IA pour surveiller et supprimer, disons à titre d’exemple, le sentiment anti-guerre, une entreprise pourrait l’utiliser pour surveiller et supprimer, disons à titre d’exemple, le sentiment anti-fast food. Le gouvernement pourrait gagner beaucoup d’argent en vendant les services des outils d’IA à des tiers. Les plateformes pourraient aussi éventuellement demander une réduction. Ainsi, les outils de censure de l’IA peuvent potentiellement profiter au gouvernement, aux plateformes technologiques et aux entreprises privées. Les incitations sont si puissantes qu’il est presque impossible d’imaginer qu’elles ne seront pas exploitées.

Pouvons-nous inverser la tendance ?

Je ne sais pas combien d’agences gouvernementales et combien de plateformes utilisent des outils de censure de l’IA. Je ne sais pas à quelle vitesse ils pourront se développer.

Je ne sais pas de quels outils nous disposons – à part sensibiliser et essayer de faire pression sur les politiciens et d’engager des poursuites pour empêcher la censure gouvernementale et réglementer l’utilisation des outils d’IA sur Internet.

Si quelqu'un a d'autres idées, c'est le moment de les mettre en œuvre.

Publié sous un Licence internationale Creative Commons Attribution 4.0

Pour les réimpressions, veuillez rétablir le lien canonique vers l'original Institut Brownstone Article et auteur.